Valutare l’AI clinica come un agente operativo, non come un dispositivo

JAMA ha appena pubblicato una riflessione molto interessante: forse l’AI clinica autonoma non dovrebbe essere approvata come un dispositivo medico.

Forse dovrebbe essere abilitata come un professionista sanitario.

La differenza è enorme.

Un dispositivo medico viene valutato per un uso definito, in un momento preciso. Ma un sistema di AI clinica può cambiare nel tempo, adattarsi al contesto, interagire con workflow diversi e assumere livelli crescenti di autonomia.

Per questo il modello “approvato una volta, valido per sempre” rischia di essere troppo debole.

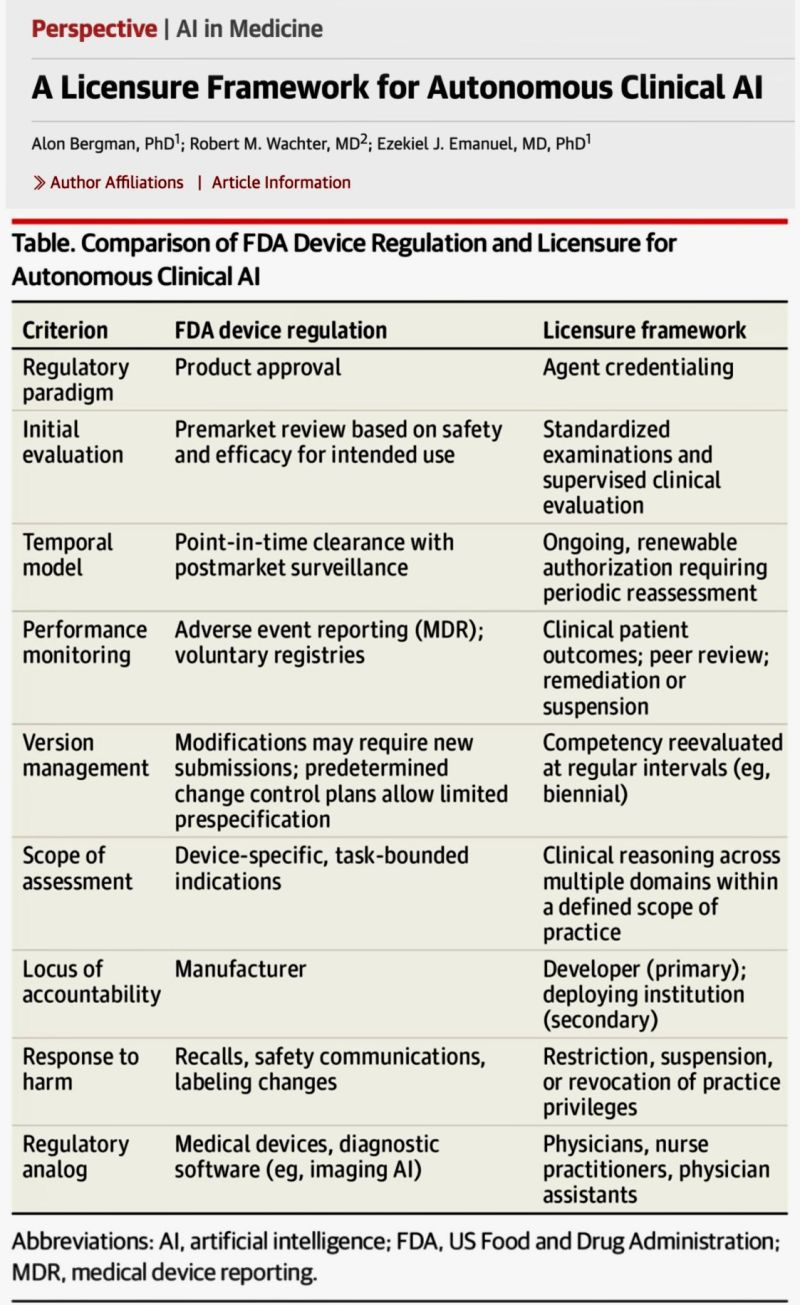

Gli autori propongono un approccio più vicino alla formazione clinica: esami di competenza, periodo supervisionato, ambito di pratica definito, rivalutazione periodica delle performance.

In altre parole: autonomia sì, ma guadagnata progressivamente.

Un’AI potrebbe iniziare con compiti semplici, come supportare il rinnovo di una terapia già nota. Poi, se dimostra affidabilità, potrebbe ampliare il proprio raggio d’azione. Sempre dentro confini chiari, con supervisione medica, metriche di sicurezza e responsabilità definite.

Questa è la parte che trovo più convincente.

La domanda non dovrebbe essere solo: “Era sicura quando l’abbiamo approvata?”

Ma: “Sta funzionando bene, oggi, in questo contesto reale?”

È una domanda molto più clinica. E molto più utile.

Naturalmente mancano ancora infrastrutture, benchmark condivisi e un quadro regolatorio maturo. Ma la direzione è giusta.

Se vogliamo AI cliniche più autonome, dobbiamo smettere di trattarle solo come software.

Dobbiamo iniziare a valutarle come agenti operativi dentro la pratica clinica: con competenze, limiti, supervisione e rivalutazione continua.

Non fiducia cieca.

Fiducia costruita.

Fonte: JAMA, “A Licensure Framework for Autonomous Clinical AI”