AI e Power Law. Perché i modelli pensano nella “testa” e non nella coda

La legge di Zipf è una di quelle idee semplici che, quando le capisci davvero, ti cambiano il modo di guardare i sistemi complessi.

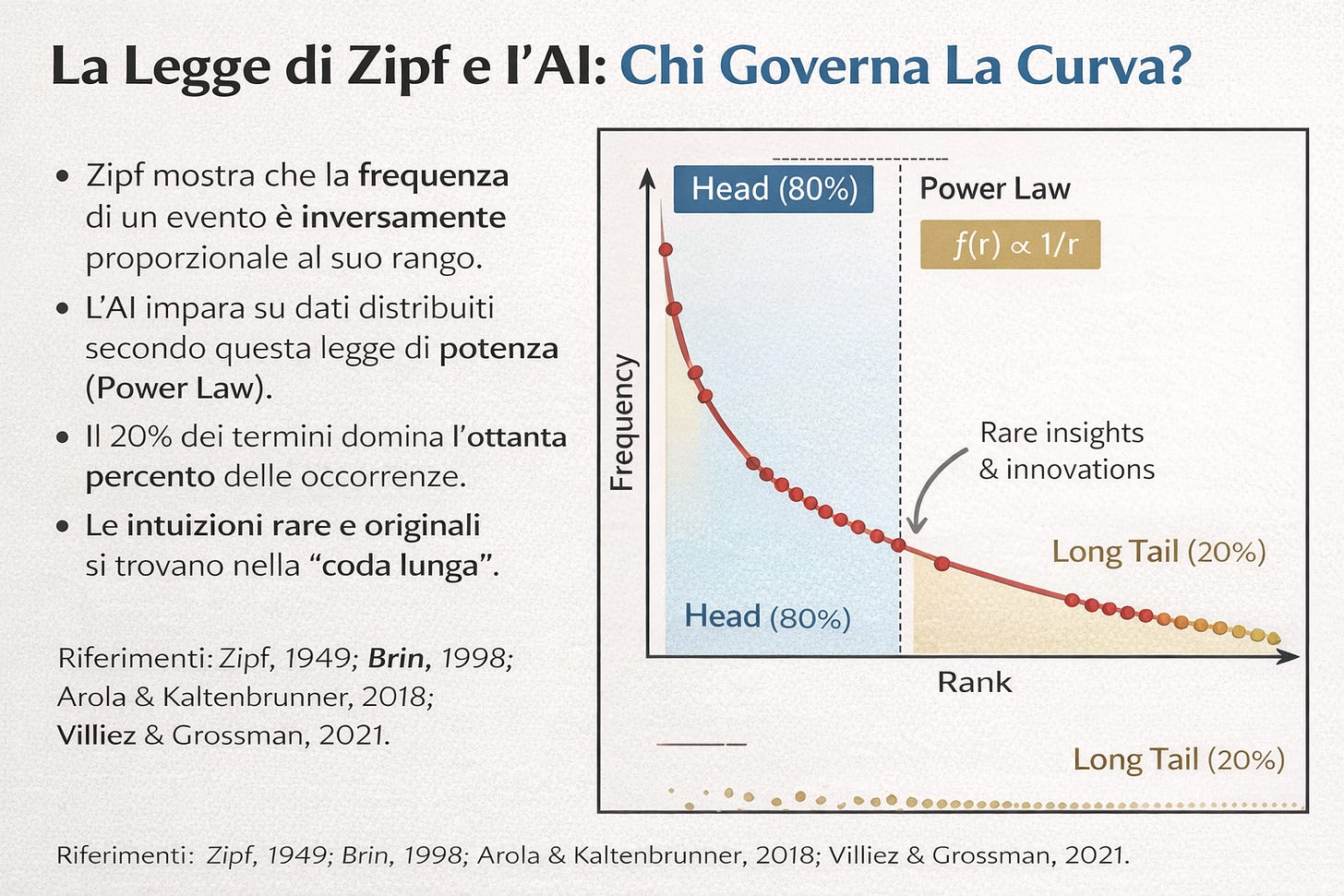

Dice questo. In un corpus linguistico, la frequenza di una parola è inversamente proporzionale al suo rango. f(r) ∝ 1/r. La parola più usata compare circa il doppio della seconda, il triplo della terza, e così via.

Non è un’anomalia linguistica. È una regolarità strutturale.

E la cosa interessante è che non vale solo per le parole.

Vale per le città. Vale per la distribuzione del reddito. Vale per le citazioni scientifiche. Vale per il traffico web. Vale per le vendite dei libri. Power law.

Sistemi complessi che si auto-organizzano e producono poche “teste” molto grandi e una lunga “coda” di elementi piccoli.

Ora portiamola sull’AI.

I modelli linguistici di grandi dimensioni non fanno altro che interiorizzare queste distribuzioni. Sono addestrati su corpora che seguono Zipf. Le loro probabilità di output riflettono strutturalmente queste curve. Le parole, i pattern, le associazioni più frequenti dominano. La “long tail” esiste, ma è molto meno probabile.

Questo ha almeno tre implicazioni concrete:

Primo. L’AI tende naturalmente verso ciò che è comune. Se non la guidi, produrrà risposte medie, statisticamente plausibili, aderenti alla distribuzione dominante. È un comportamento coerente con la legge che governa i dati su cui è stata addestrata.

Secondo. L’innovazione sta spesso nella coda lunga. Le intuizioni originali, le nicchie cliniche, i casi rari, le combinazioni inedite vivono in zone a bassa frequenza. Per intercettarle servono prompt strutturati, vincoli, contesto, dataset specialistici. Altrimenti la gravità statistica ti riporta verso il centro.

Terzo. Anche l’ecosistema AI segue Zipf. Pochi modelli dominano il mercato. Poche piattaforme concentrano l’attenzione. Moltissimi tool restano marginali. È una dinamica di concentrazione tipica dei sistemi complessi con effetti di rete.

Sappiamo lavorare contro l’inerzia della distribuzione quando serve?

Se vuoi un’AI che ti aiuti davvero nel decision making clinico, nella ricerca o nella strategia, non puoi accontentarti della risposta più probabile. Devi progettare il contesto per esplorare la coda lunga in modo controllato. Devi aumentare la varianza quando cerchi ipotesi. Devi ridurla quando cerchi affidabilità.

Capire Zipf significa capire che l’AI non è “intelligente” nel senso umano. È un motore probabilistico immerso in distribuzioni di potenza.

E se governi le distribuzioni, governi il comportamento.

Il punto non è usare l’AI.

È sapere in quale parte della curva vuoi stare.

Riferimenti e Bibliografia:

1) Origine e testo classico di Zipf

• George Kingsley Zipf – Human Behavior and the Principle of Least Effort (1949). Il testo fondativo in cui Zipf introduce la legge empirica del rango-frequenza, applicata alla linguistica e ai sistemi sociali.

https://archive.org/details/humanbehaviorpri0000zipf (Internet Archive)

2) Rassegna critica e ricerche su Zipf nella linguistica quantitativa

• Zipf’s word frequency law in natural language: A critical review and evaluation – PubMed Central. Rivede spiegazioni e modelli per il fenomeno, utile per contestualizzare scientificamente Zipf. (PMC)

https://pmc.ncbi.nlm.nih.gov/articles/PMC4176592/ (PMC)

3) Applicazioni moderne e formalizzazioni statistiche

• Some Properties of Zipf’s Law and Applications, MDPI Axioms (2024). Articolo peer-review che discute proprietà, generalizzazioni e casi d’uso di Zipf. (MDPI)

https://www.mdpi.com/2075-1680/13/3/146 (MDPI)

4) Grandi dataset e verifica empirica

• Large-Scale Analysis of Zipf’s Law in English Texts, PLOS One. Analisi quantitativa su decine di migliaia di testi, confermando distribuzioni di potenza. (PLOS)

https://journals.plos.org/plosone/article?id=10.1371/journal.pone.0147073 (PLOS)

5) Studi cross-linguistici su Zipf

• Zipf’s law in 50 languages: structural pattern & cognitive motivation (arXiv). Indagine su molte lingue naturali con implicazioni cognitive e statistiche. (arXiv)

https://arxiv.org/abs/1807.01855 (arXiv)

6) Connessioni a modelli linguistici e AI generativa

• Zipf’s Law and Its Application in Large Language Models (Springer, prossima pubblicazione). Specifica relazione tra legge di Zipf e text generation nei LLM, può essere citata per collegare la legge ai modelli AI. (Springer)

https://link.springer.com/chapter/10.1007/978-981-96-9248-4_4 (Springer)

7) Encyclopedic overview

• Encyclopaedia Britannica – voce Zipf’s law, con formula, esempi e generalizzazioni. Ottimo riferimento di sintesi autorevole. (Encyclopedia Britannica)

https://www.britannica.com/topic/Zipfs-law (Encyclopedia Britannica)